AI大模型+内容审核:构建绿色网络环境

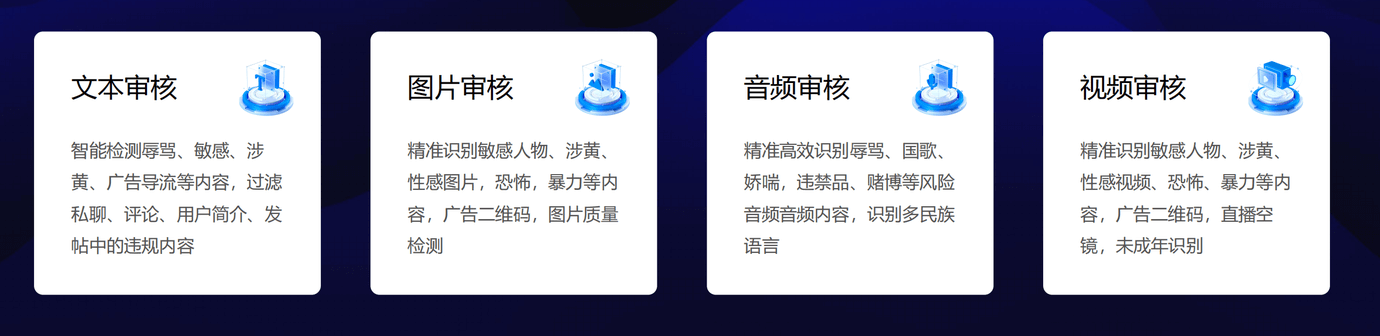

随着互联网上的内容爆炸式增长,内容审核成为了企业和组织维护网络健康、保障用户权益所面临的重要挑战。内容审核是指对互联网上的内容进行评估和判断的过程,以确定内容是否符合相关政策和规定,以及是否有害、违法等,它主要包括文本、图像、音频和视频等多种形式的内容。

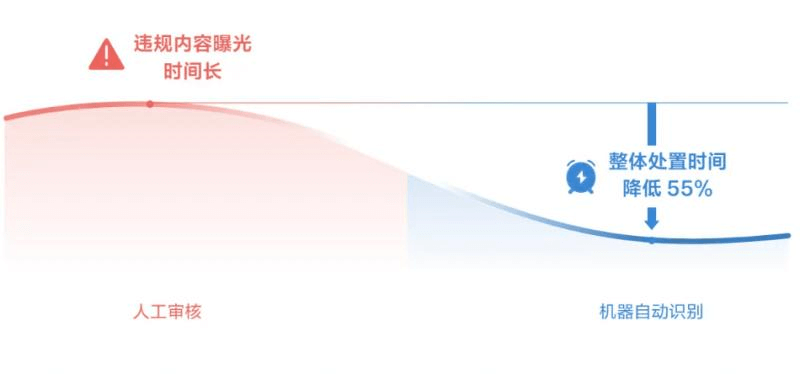

传统的人工审核方式不仅效率低下,而且难以应对海量的数据。AI大模型以其强大的处理能力和智能化特性,为内容审核带来了革命性的变革。大模型在内容审核领域具有广泛的应用前景,可集成多种AI大模型,能够满足不同场景下的内容审核需求,可以帮助企业和组织更有效地管理和审核内容,提供更加先进的内容审核解决方案,助力企业实现数字化转型和智能化升级。本文将浅谈一下AI大模型在内容审核中的核心技术、应用场景以及未来发展趋势与挑战。

一、AI大模型在内容审核中的核心技术

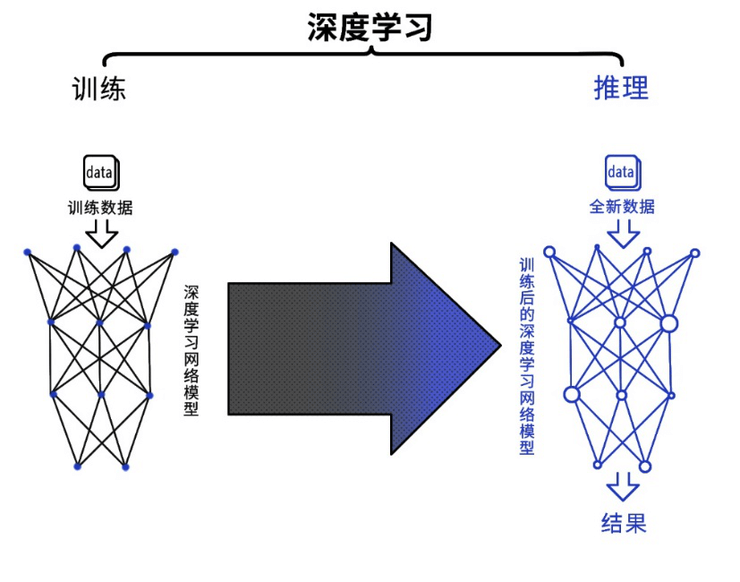

AI大模型是指具有大规模参数量和复杂结构的人工智能模型,如BERT、GPT等。这些模型通过深度学习技术,能够处理复杂的任务,如图像识别、自然语言处理等。在内容审核领域,AI大模型能够自动化地对内容进行审核,提高审核效率和准确性,它主要依赖以下核心技术:

卷积神经网络(CNN):CNN是一种深度学习模型,主要应用于图像识别和处理。通过卷积和池化操作,CNN能够提取图像中的特征,减少参数数量和计算量,提高模型的效率和准确性,以识别违法或有害的图像内容。例如在内容审核中,CNN可以识别色情、暴力、血腥等敏感图像内容,捕捉到图片中的敏感区域和特征,从而进行准确判断,实现自动化审核。

递归神经网络(RNN):RNN是一种处理序列数据的深度学习模型,能够捕捉文本序列中的长距离依赖关系。在内容审核中,RNN可以分析文本中的逻辑关系和语义信息,判断文本的真实性,识别如谣言、欺诈信息、敏感词汇、不当言论和恶意诋毁等文本内容。

二、AI大模型在内容审核中的应用

AI大模型在内容审核中的应用场景广泛,主要包括以下几个方面:

(1)自动化审核:

AI大模型通过训练大量数据,能够自动识别并过滤违法、有害的内容。例如,在社交媒体平台上,AI大模型可以自动检测并删除包含暴力、色情、仇恨言论等敏感内容,保护用户免受不良信息的侵扰。自动化审核不仅提高了审核效率,还降低了人工审核的成本和错误率。

(2)风险预警:

通过AI大模型对内容的深度分析,进行风险预警,提前发现潜在的风险点,如谣言、欺诈信息等违法、有害的内容。这种预警机制有助于企业和组织及时采取措施,防止风险扩大,保护用户权益。

(3)内容分类和标签:

AI大模型能够根据内容的特点自动进行分类和标签,便于管理和查询。例如在新闻网站上,AI大模型可以将新闻内容分为政治、经济、娱乐等不同类别,并打上相应的标签,有助于用户快速找到感兴趣的内容,也便于网站对内容进行管理和推荐。

(4)内容生成:

AI大模型还可以生成符合规定的内容,减轻人工内容生成的压力。例如,在电商平台上,AI大模型可以根据商品信息和用户需求生成商品描述、推广文案等,提高内容的多样性和吸引力。

三、AI大模型在内容审核中的未来发展趋势

AI大模型在内容审核中的未来发展趋势主要包括以下几个方面:

算法和模型的不断优化:随着算法和模型的不断发展,AI大模型在内容审核中的性能将得到进一步提升,提供更准确和更快的审核结果。

跨媒体内容审核:未来,AI大模型将能够实现对文本、图片、音频、视频等多种媒体内容的跨媒体审核,提高内容审核的全面性和准确性。

智能化程度提升:AI大模型将结合更多的智能化技术,如自然语言理解、情感分析等,实现更加智能化的内容审核和风险管理。

目前AI大模型在内容审核应用方面取得的显著成效,无疑是网络安全领域的一个重大突破。尽管有时候一些正常的内容可能会因为某些关键词或者画面的相似性而被误判为违规。但在未来,随着算法和模型的持续发展以及智能化程度的提升,不断地对系统进行优化和调整,提高它的精准度,AI大模型将在守护网络世界的纯净和安全方面发挥着更加重要的作用,营造更加健康、和谐的网络环境。